21/08/2006

La lucha contra la contaminación del aire se ha convertido en una de las batallas más cruciales de nuestra era. Más allá de las políticas públicas y las acciones individuales, la ciencia y la tecnología nos ofrecen herramientas cada vez más sofisticadas para entender y, sobre todo, anticipar los picos de polución que amenazan nuestra salud y la del planeta. En este escenario, los modelos predictivos, alimentados por enormes cantidades de datos, emergen como faros capaces de guiarnos hacia un futuro más respirable. Sin embargo, su eficacia depende de un factor crítico y a menudo subestimado: la calidad de los datos con los que se entrenan. Este artículo se sumerge en el fascinante mundo de la predicción de la calidad del aire, explorando los métodos existentes, sus desafíos y cómo un estudio de caso en Calcuta, India, nos revela lecciones sorprendentes.

- La Urgencia de Predecir: ¿Por Qué Mirar al Futuro del Aire?

- Las Herramientas del Pronóstico: Un Duelo entre lo Clásico y lo Moderno

- Tabla Comparativa: Estadísticos vs. Deep Learning

- El Talón de Aquiles: La Contaminación de los Datos

- Lecciones desde Calcuta: Más Complejo no Siempre es Mejor

- Preguntas Frecuentes (FAQ)

- Conclusión: Hacia un Futuro Guiado por Datos Limpios

La Urgencia de Predecir: ¿Por Qué Mirar al Futuro del Aire?

Anticipar los niveles de contaminación atmosférica no es un mero ejercicio académico. Para los gobiernos y las agencias medioambientales, una predicción precisa es la base para la formulación de políticas eficientes. Permite activar alertas tempranas a la población, especialmente a los grupos vulnerables como niños, ancianos y personas con enfermedades respiratorias. También facilita la toma de decisiones estratégicas, como la restricción temporal del tráfico vehicular o la paralización de ciertas actividades industriales antes de que la situación se vuelva crítica. En esencia, predecir la contaminación es pasar de una postura reactiva a una proactiva, salvando vidas y mejorando la calidad de vida urbana.

Las Herramientas del Pronóstico: Un Duelo entre lo Clásico y lo Moderno

Para predecir la concentración de partículas nocivas como las PM2.5 y PM10, los científicos de datos emplean un arsenal de técnicas que pueden agruparse en dos grandes familias: los métodos estadísticos tradicionales y los modelos de aprendizaje profundo (Deep Learning), una rama de la inteligencia artificial.

Métodos Estadísticos: La Sabiduría de la Experiencia

Estos modelos, que han sido la columna vertebral del análisis de series temporales durante décadas, se basan en principios matemáticos para identificar patrones, tendencias y estacionalidades en los datos históricos.

- AR (Autorregresivo): Es un modelo simple que asume que el valor futuro de una variable depende de sus valores pasados. Es como decir que la contaminación de mañana estará influenciada por la de hoy y la de ayer.

- SARIMA (Media Móvil Integrada Autorregresiva Estacional): Una versión mucho más potente y compleja. El SARIMA no solo considera las tendencias y los valores pasados, sino que también es capaz de modelar los patrones estacionales. Por ejemplo, puede aprender que la contaminación tiende a ser más alta en invierno debido a las condiciones meteorológicas y al uso de calefacción.

- Holt-Winters: Este método es especialmente bueno para manejar datos que presentan tanto una tendencia (por ejemplo, un aumento gradual de la contaminación a lo largo de los años) como una estacionalidad (picos y valles recurrentes).

La gran ventaja de estos métodos es su interpretabilidad. Los expertos pueden entender por qué el modelo hace una determinada predicción, lo que genera confianza y facilita la validación de los resultados.

Deep Learning: El Poder de Aprender Patrones Complejos

En la otra esquina del ring se encuentran las redes neuronales profundas. Estos modelos, inspirados en el funcionamiento del cerebro humano, son capaces de aprender relaciones increíblemente complejas y no lineales en los datos que a menudo pasan desapercibidas para los métodos estadísticos.

- Redes LSTM (Long Short-Term Memory): Son un tipo de red neuronal recurrente especialmente diseñada para trabajar con secuencias de datos, como las series temporales de contaminación. Tienen la capacidad de "recordar" información de pasos temporales muy lejanos, lo que las hace muy potentes para predicciones a largo plazo.

- Variantes Avanzadas: El estudio mencionado en Calcuta exploró versiones aún más sofisticadas, como redes LSTM apiladas (Stacked), bidireccionales (Bi-directional), autoencoders y convolucionales, cada una diseñada para capturar diferentes matices de los patrones de datos.

Tabla Comparativa: Estadísticos vs. Deep Learning

Para visualizar mejor las fortalezas y debilidades de cada enfoque, aquí presentamos una tabla comparativa:

| Característica | Métodos Estadísticos (SARIMA, etc.) | Métodos de Deep Learning (LSTM, etc.) |

|---|---|---|

| Requerimiento de Datos | Moderado. Pueden funcionar bien con conjuntos de datos limitados. | Alto. Requieren grandes volúmenes de datos para aprender eficazmente. |

| Complejidad del Modelo | Baja a media. Los principios matemáticos son bien conocidos. | Muy alta. A menudo se consideran "cajas negras". |

| Interpretabilidad | Alta. Es posible entender la lógica detrás de la predicción. | Baja. Es difícil saber exactamente por qué el modelo toma una decisión. |

| Rendimiento (Caso Calcuta) | Superior con los datos disponibles. | Inferior, probablemente debido a la cantidad limitada de datos. |

| Necesidad Computacional | Baja. Pueden ejecutarse en ordenadores convencionales. | Alta. A menudo requieren hardware especializado (GPUs). |

El Talón de Aquiles: La Contaminación de los Datos

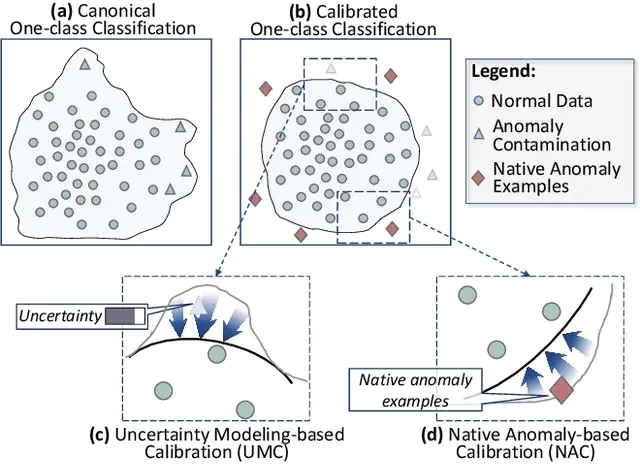

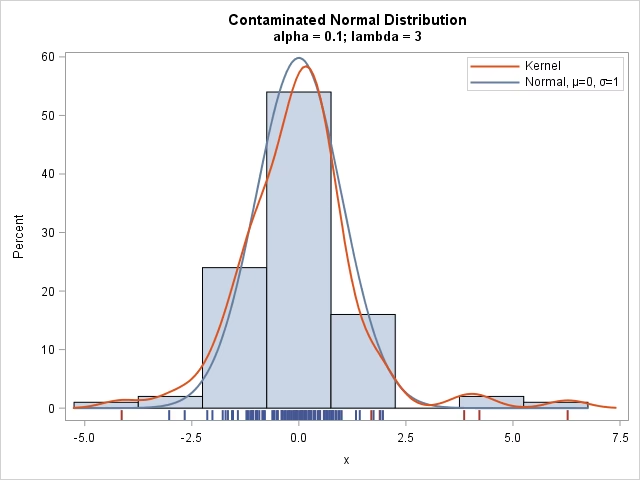

Independientemente del modelo elegido, existe un supuesto fundamental que a menudo se pasa por alto: que los datos de entrenamiento están limpios y libres de anomalías. En la práctica, esta suposición es poco realista. Los sensores de monitoreo pueden fallar, registrar valores erróneos o sufrir interrupciones. Eventos anómalos, como un incendio forestal cercano o un accidente industrial, pueden generar picos de contaminación que no son representativos del patrón habitual.

Cuando un modelo predictivo se entrena con estos datos "contaminados", aprende patrones incorrectos. Esto conduce a una disminución dramática de su robustez y fiabilidad en el mundo real. Es el equivalente a estudiar para un examen con un libro lleno de erratas; el resultado final será, inevitablemente, deficiente. Por ello, la comunidad científica está desarrollando enfoques novedosos y robustos, como el mencionado RoCA, diseñados específicamente para ser resistentes a estas anomalías en los datos de entrenamiento, garantizando predicciones más fiables incluso cuando la información de partida no es perfecta.

Lecciones desde Calcuta: Más Complejo no Siempre es Mejor

El estudio realizado en Calcuta para pronosticar las tendencias de PM2.5 y PM10 a dos años vista arrojó un resultado sorprendente y profundamente instructivo. A pesar del potencial teórico de las complejas redes de Deep Learning, los métodos estadísticos clásicos como SARIMA y Holt-Winters ofrecieron predicciones más precisas. La razón principal parece ser la cantidad de datos disponibles. Los modelos de Deep Learning son "hambrientos" de datos; necesitan miles de ejemplos para poder desentrañar los patrones subyacentes. Con un conjunto de datos más limitado, como el que a menudo se encuentra en aplicaciones del mundo real, los modelos estadísticos, más simples y con supuestos más fuertes, lograron un mejor rendimiento. Esta es una lección vital: la elección de la herramienta debe adaptarse al problema y a los recursos disponibles, y no simplemente optar por la tecnología más nueva o compleja.

Preguntas Frecuentes (FAQ)

¿Qué son las partículas PM2.5 y PM10?

Son partículas en suspensión en el aire. El número indica su diámetro en micrómetros. Las PM10 tienen un diámetro de 10 micrómetros o menos, y las PM2.5 (también conocidas como partículas finas) son aún más pequeñas, con 2.5 micrómetros o menos. Debido a su diminuto tamaño, las PM2.5 son particularmente peligrosas, ya que pueden penetrar profundamente en los pulmones y entrar en el torrente sanguíneo.

¿Por qué un modelo más simple puede ser mejor que uno de IA?

Un modelo de IA como una red neuronal profunda necesita una gran cantidad de datos para aprender patrones complejos sin hacer suposiciones previas. Si los datos son escasos, el modelo puede "sobreajustarse", es decir, memorizar el ruido y las peculiaridades de los datos de entrenamiento en lugar de aprender la tendencia general. Un modelo estadístico más simple, con sus reglas matemáticas incorporadas, es menos propenso a este problema y puede generalizar mejor a partir de menos información.

¿Qué futuro le espera a la predicción de la contaminación?

El futuro probablemente reside en un enfoque híbrido. Combinar la interpretabilidad y la eficiencia de los modelos estadísticos con la capacidad del Deep Learning para capturar relaciones complejas a partir de grandes volúmenes de datos (incluyendo datos de satélites, tráfico, meteorología, etc.). Además, el desarrollo de modelos robustos a datos imperfectos será clave para su aplicación práctica y fiable a nivel global.

Conclusión: Hacia un Futuro Guiado por Datos Limpios

La predicción de la calidad del aire es un campo en plena ebullición que se sitúa en la intersección de la ciencia ambiental, la estadística y la inteligencia artificial. Si bien las herramientas a nuestra disposición son cada vez más poderosas, los estudios de caso como el de Calcuta nos recuerdan la importancia de los fundamentos: la calidad y cantidad de los datos son primordiales. Un modelo, por muy avanzado que sea, es inútil si se alimenta de información errónea. El camino hacia un aire más limpio no solo requiere tecnología de vanguardia, sino también un compromiso riguroso con la recopilación, limpieza y validación de los datos que impulsan nuestras decisiones para proteger la salud pública y el futuro de nuestro planeta.

Si quieres conocer otros artículos parecidos a Modelos Predictivos y Contaminación del Aire puedes visitar la categoría Ecología.